Cum poate fi oprit bombardamentul cu știri false lansate pe Twitter sau Facebook

Poate fi combătută eficient puzderia de informații false publicate și rostogolite pe Facebook și pe Twitter? Este o soluție corectă ștergerea postărilor care pot fi dovedite drept neadevărate?

Acest articol a apărut în numărul 61 (18 – 31 martie 2019) al revistei NewMoney

Reprezentanții platformelor social media afirmă că nu este treaba lor să se asigure că tot ceea ce scriu oamenii pe site-urile lor este adevărat. „În niciun caz nu ne dorim să fim arbitrii adevărului“, declara în 2017, pentru BBC, Sheryl Sandberg, chief operating officer al companiei Facebook Inc. Această poziție este de înțeles: nu numai că munca de a verifica fiecare postare ar fi enormă, dar cenzura i-ar deranja pe mulți dintre cei mai activi utilizatori ai rețelelor.

Pe de altă parte, informațiile false care rămân din abundență pe site-urile importante pot avea consecințe groaznice. În Myanmar, postările virulente de anul trecut ale naționaliștilor budiști au incitat la purificare etnică și la violențe împotriva minorității Rohingya (de religie musulmană, n.r.). În 2016, un bărbat din statul american North Carolina a tras cu pușca de mai multe ori într-o pizzerie din Washington. El a crezut afirmațiile false incluse în câteva filmulețe de pe YouTube, potrivit cărora respectivul restaurant adăpostea ritualuri satanice cu copii în care era implicată și Hillary Clinton (în acel an, rivala lui Donald Trump în alegerile prezidențiale din SUA, n.r.). Și exemplele ar putea continua.

SOFTWARE ȘI OAMENI. Așadar, care este soluția? Un raport publicat recent – realizat de Centrul pentru Afaceri și pentru Drepturile Omului de la Școala de Afaceri Stern din cadrul New York University – susține că platformele sociale ar trebui să elimine materialul care este, demonstrabil, neadevărat. Aceasta, mai degrabă decât ca respectivul material să fie doar retrogradat sau adnotat, așa cum se procedează acum în unele cazuri.

Orice material din zona gri, situat undeva între adevărat și fals, ar putea fi păstrat, consideră autorul raportului, Paul Barrett, director adjunct al Centrului, fost redactor la revista Bloomberg Businessweek. Acesta exemplifică: „O poveste lungă cu titlul «Holocaustul nu a avut loc niciodată» poate fi demonstrată ca fiind neadevărată și ar trebui să fie eliminată din acest motiv. Prin contrast, o poveste intitulată «Democrații favorizează în secret frontierele deschise» ar putea fi neîntemeiată și înșelătoare, dar nu se poate demonstra că este falsă“.

O cenzurare a unui material despre care se poate dovedi că este fals nu ar încălca dreptul la libertatea de exprimare prevăzut de Primul Amendament (la Constituția SUA, n.r.), deoarece Primul Amendament se aplică numai acțiunilor guvernului. O firmă privată, cum sunt Facebook, Twitter Inc. sau Alphabet Inc. – compania-mamă a platformei YouTube –, poate să aleagă ce conținut vrea să afișeze.

„Algoritmii pe care-i construiesc ordonează miliarde de postări și de tweet-uri, făcând inevitabil niște alegeri în privința conținutului afișat utilizatorilor. Uneori, aplicând o combinație de software și discernământ uman, companiile deja elimină conținut sau chiar îi interzic pe respectivii utilizatori cu totul. Poziția noastră este că ele ar trebui să facă pasul următor și să acționeze mai energic pentru a diminua volumul de conținut fals generat în rețea“, indică raportul realizat de Paul Barrett.

CONȚINUT CONTAGIOS. Din nefericire, ștergerea materialului fals într-un mod echitabil este mult mai ușor de zis decât de făcut, după cum scrie David French într-un articol publicat de National Review. O problemă neprevăzută este aceea că lucrătorii angajați de Facebook să cenzureze conținutul pot deveni atât de traumatizați de expunerea la teoriile conspirației, încât ei înșiși încep să le creadă. Într-un articol intitulat „Etajul traumei“, publicat pe site-ul TheVerge.com, Casey Newton scrie: „Un cenzor promovează ideea că Pământul este plat. Un fost angajat mi-a spus că a început să pună sub semnul întrebării anumite aspecte ale Holocaustului. Un alt fost angajat, care mi-a spus că a făcut o schiță cu toate căile de evacuare din locuința sa și care doarme cu o armă lângă el, mi-a mărturisit: «Nu mai cred că pe 11 septembrie a fost un atac terorist»“.

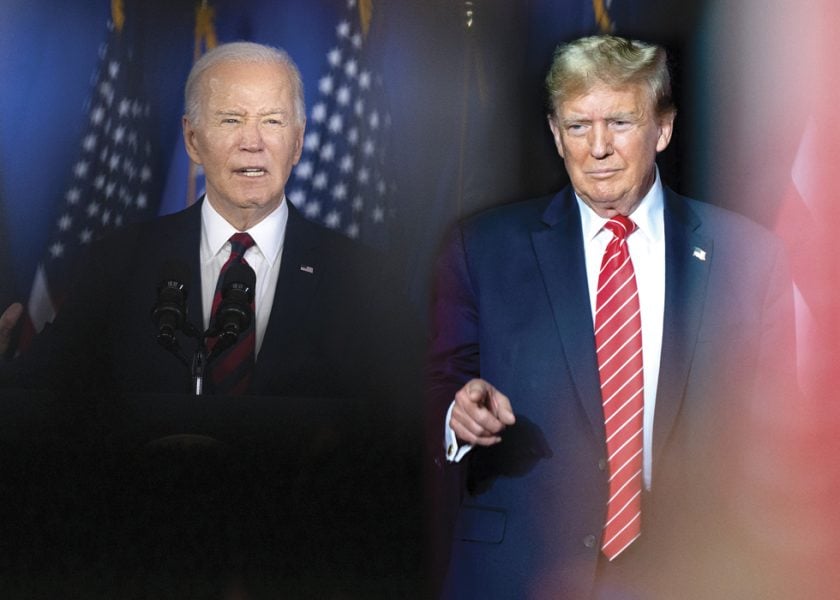

EXEMPLUL TRUMP. O altă problemă ar fi ce este de făcut când un lider mondial – să zicem, președintele Donald Trump – publică în rețea ceva ce este, demonstrabil, neadevărat. Twitter a abordat această chestiune într-un comunicat dat publicității anul trecut. „Blocarea unui lider mondial pe rețeaua Twitter sau ștergerea tweet-urilor sale controversate ar ascunde informații importante pe care oamenii ar trebui să le poată vedea și să le poată dezbate. De asemenea, măsura nu l-ar împiedica să vorbească pe acel lider, dar cu siguranță ar împiedica o discuție necesară în privința cuvintelor și a acțiunilor acestuia“, au scris reprezentanții companiei în comunicatul respectiv. Raportul Centrului este, în esență, de acord cu acest lucru. În schimb, recomandă: „Twitter trebuie să ia în calcul curățarea activă a numeroaselor comentarii contradictorii pe care le provoacă aceste tweet-uri“. Paul Barrett a scris într-un e-mail: „Niciun sistem nu poate fi perfect când încerci să definești și apoi să ștergi falsurile și teoriile conspirației“.

Articol preluat din BloombergBusinessweek

de Peter Coy; adaptare de Mimi Noel

FOTO: Guliver / Getty Images